朋友们,阿里最近的AI势头有点猛啊。

还记得前几天的快乐小马「HappyHorse」吧,在视频模型榜单杀疯了。

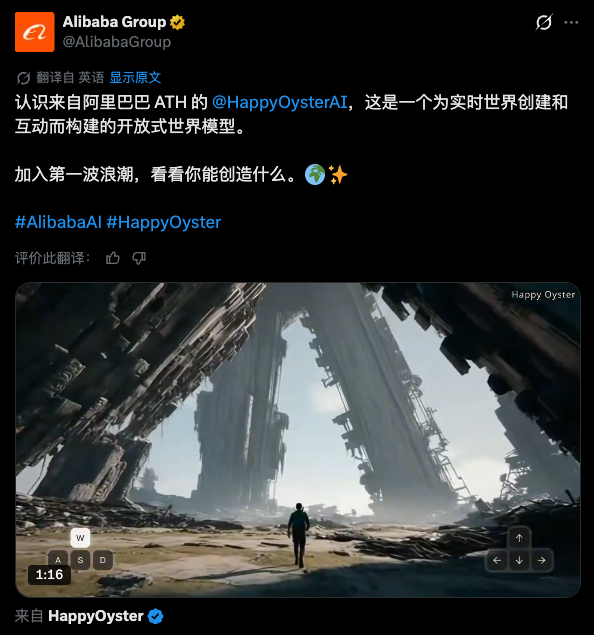

昨天,同样是阿里ATH事业群,发布了一个名为「HappyOyster」的开放式世界模型。咱也不知道ATH咋这么快乐,上次是小马,这次是生蚝。

在HappyOyster中,可以实时创建世界,并与之交互。看完下面的官方短片,你就知道这是什么,以及它有多强了,HappyOyster提供了两种模式:漫游和导演。

在漫游模式里,你丢给它一句话或一张图,它就能瞬间扩展出一个具备物理一致性的三维空间。

你可以以第一人称视角在里面自由走动,镜头的光影会随着你的脚步自然流转。当你回过头时,刚才路过的那个杯子、那棵树,依然在原地。

这种环境的持续性,是世界模型与普通视频模型的分水岭。目前,它支持长达1分钟的连续实时位移探索。虽然只有480p的分辨率,但那种身临其境的推背感,足以让人头皮发麻。

导演模式则更像是一种即兴创作。它能生成长达3分钟的720p实时画面。

你可以随时喊咔,通过文字、图片甚至语音来修改画面。

这种实时性,让它跟谷歌前段时间发布的Genie 3站在了同一水平线。但相比之下,阿里的HappyOyster走得更远一些。它在时序建模上的跨度更长,而且独家提供了那种随时干预剧情的导演权力。

支撑起HappyOyster世界的,是叫做“原生多模态”的架构。

过去的技术方案像是在搭积木,一个模态负责看,一个模态负责算,最后强行拼凑在一起。这就好比一个乐团,乐手之间互不认识,全靠指挥死撑,效率极低且容易出错。

HappyOyster则是一出生就带着统一的灵魂。它在最底层就完成了文本、图像、音频的流式处理。这意味着,模型在生成的每一毫秒都在接收你的指令,每一帧画面都在实时响应你的念头。

它像是一个懂物理规律的造物主。在它模拟的世界里,光照、重力、角色的动作惯性,都遵循着某种内在的因果逻辑。

如果你是做影视的,这种效率提升简直是降维打击。导演不再需要盯着黑乎乎的剧本空想,也不用等待漫长的后期渲染。你只需要描述一段场景,画面立刻跳出来。不满意?当场改,当场看。

如果你是游戏开发者,在原型阶段,你甚至不需要美工和关卡设计介入。丢一个概念进去,一个可玩、可走、可交互的Demo就出来了。

甚至在文旅和教育领域,它也正在打破现实与虚拟的墙。

想象一下,你直接走进《清明上河图》,去路边摊买一碗宋朝的茶,跟桥上的行人交谈,甚至改变历史的走向。这种从被动观看到深度沉浸的跃迁,才是技术最温情的时刻。

世界模型这类技术,甚至还可以延伸到智能硬件上。当你戴上AR眼镜,HappyOyster可以根据你的动作和环境,实时在你眼前生成一段与现实共振的数字内容。

从HappyHorse到HappyOyster,阿里ATH正在做的事,其实是赋予AI一种“模拟生命”的能力。

我们曾经以为,AI只是一个聪明的万事通,或者一个画技精湛的画师。但现在,它开始尝试构建一个能够自洽运行的宇宙。

在那个宇宙里,每一朵花的绽放,每一滴雨的坠落,都带着真实生命力的灵动。

2026年,也许真的是世界模型的元年。

我们正在从预测下一个字,走向模拟整个世界。这不仅是为了好玩,它是通往物理AI的必经之路。

当数字世界开始拥有重力,当AI开始理解因果,我们离真正的AGI也就并不遥远了。

如果你有任何看法,欢迎在评论区一起讨论

如果有一点收获,可以点赞、转发、推荐文章,关注「AI机器人茶馆」